La inteligencia artificial (IA) ha avanzado a pasos agigantados en los últimos años, y su integración en el ámbito militar plantea serias preocupaciones sobre la seguridad global. Expertos en ética y tecnología han comenzado a advertir que el uso de la IA en conflictos bélicos podría no solo cambiar la forma en que se libran las guerras, sino también aumentar el riesgo de una catástrofe nuclear. En este contexto, se hace urgente la necesidad de establecer acuerdos internacionales que regulen el uso de esta tecnología en el ámbito militar.

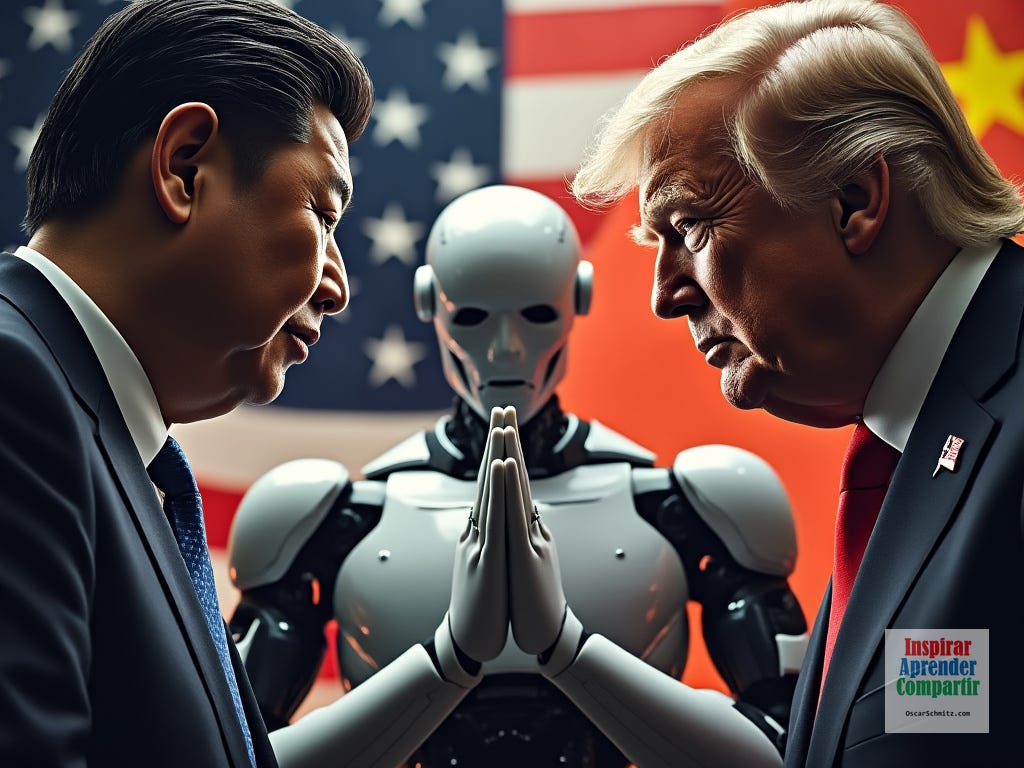

El director del Instituto de Ética en IA de la Universidad de Oxford, John Tasioulas, ha señalado que la posibilidad de una guerra nuclear es más probable que la aniquilación de la humanidad por robots. Esta afirmación resuena en un momento en que las potencias mundiales, como Estados Unidos y China, están invirtiendo en el desarrollo de tecnologías militares impulsadas por IA. La creciente sofisticación de estas herramientas podría acelerar la toma de decisiones en situaciones de crisis, lo que aumenta el riesgo de errores fatales.

### La Carrera Armamentista de la IA

La carrera por la supremacía en IA militar ha llevado a países como China y Estados Unidos a reforzar sus arsenales nucleares y desarrollar drones autónomos y otras armas que operan sin intervención humana. Este enfoque plantea un dilema ético y estratégico: ¿cómo se puede garantizar que estas tecnologías se utilicen de manera responsable y controlada? La falta de regulación y la negativa de algunos países a comprometerse con acuerdos internacionales sobre el uso de la IA en el ámbito militar son motivo de preocupación.

Un informe reciente destaca la necesidad de que las naciones desarrollen competencias en torno a la IA y promuevan normas para su uso seguro. Los autores del estudio argumentan que gestionar eficazmente las cuestiones relacionadas con la IA y la energía nuclear es esencial para reforzar tanto la disuasión como la estabilidad global. Esto implica no solo la creación de políticas que evalúen los riesgos asociados con la IA, sino también la integración de esta tecnología en las iniciativas diplomáticas relacionadas con la seguridad nuclear.

La situación se complica aún más por la negativa de China a firmar acuerdos que buscan mantener el control humano sobre las decisiones relacionadas con el uso de armas nucleares. Este rechazo ha encendido alarmas en la comunidad internacional, ya que sugiere una falta de compromiso con los principios éticos que deberían guiar el desarrollo y uso de la IA en el ámbito militar. Sin un consenso global, el riesgo de que la IA desencadene un conflicto bélico se incrementa significativamente.

### La Necesidad de un Acuerdo Internacional

La advertencia de expertos en IA es clara: es fundamental que países como Estados Unidos y China, junto con otros actores clave, lleguen a un acuerdo sobre la regulación del uso de la inteligencia artificial en contextos militares. La cooperación internacional es esencial para mitigar los riesgos asociados con la IA y la energía nuclear. Tasioulas enfatiza que uno de los grandes retos es asegurar que el uso de la IA en el ámbito militar esté bajo control humano, especialmente en lo que respecta a las armas nucleares.

Los especialistas sugieren que, para evitar una escalada nuclear, es necesario establecer un marco regulatorio que contemple no solo el desarrollo de tecnologías, sino también su implementación y uso en situaciones de conflicto. Esto incluye la creación de un conjunto integral de reducción de riesgos que evalúe todos los procesos relacionados con la energía nuclear y la IA. La falta de acción en este sentido podría tener consecuencias devastadoras para la humanidad.

En este contexto, es crucial que los líderes mundiales reconozcan la urgencia de abordar estos problemas de manera proactiva. La historia ha demostrado que la falta de regulación y control en el desarrollo de tecnologías avanzadas puede llevar a resultados catastróficos. Por lo tanto, es imperativo que se establezcan normas claras y se fomente el diálogo entre las naciones para garantizar que la IA se utilice de manera responsable y ética en el ámbito militar.

La intersección entre la inteligencia artificial y las armas nucleares es un tema que no puede ser ignorado. A medida que avanzamos hacia un futuro cada vez más dependiente de la tecnología, es esencial que se tomen medidas para garantizar que estas herramientas se utilicen para promover la paz y la seguridad, en lugar de convertirse en catalizadores de destrucción masiva. La cooperación internacional y la regulación efectiva son pasos necesarios para evitar que la IA se convierta en una amenaza existencial para la humanidad.